LE BLOG SEO

Le SEO est un discipline en évolution permanente, elle nécessite une veille permanente afin de suivre au plus près les nouvelles mise à jour de Google.

Vous trouverez dans ce blog les informations nécessaires pour vous aider à bien comprendre le fonctionnement du SEO ainsi que de nombreux conseils pour optimiser votre site. Nos experts SEO partagent leur expérience et leur point de vue sur les bonne pratiques SEO et les techniques qu’il faut éviter.

Conseils et avis d’experts

pour progresser en SEO

Qu’est-ce que le contenu scrappé ? On parle de « scraping content » (contenu scrappé) lorsqu’un site web explore un autre site et duplique son contenu au lieu de créer un contenu original pour lui-même. Ce formulaire est un premier pas vers le changement et la pénalisation de contenu scrappé. Il n’y

Sommaire1 Que sont les balises canoniques et les URLs canoniques ?2 Quelle est la différence entre les balises canoniques et les URL canoniques ? Et existe-t-il d’autres moyens de les spécifier ?2.1 Balises canoniques3 URLs canoniques4 Comment spécifier autrement les URL canoniques ?5 L’URL canonique peut-elle résoudre des problèmes de

Les redirections La redirection est le processus qui consiste à transférer une URL vers une autre URL. C’est un moyen d’envoyer à la fois les utilisateurs et les moteurs de recherche vers une URL différente de celle qu’ils ont demandée à l’origine. Les trois redirections les plus couramment utilisées sont

Qu’est-ce que le Google Panda en SEO ? Google Panda est le nom officiel d’une mise à jour de l’algorithme de Google visant à réduire la prévalence des contenus de faible qualité dans les résultats de recherche et à récompenser les contenus uniques et attrayants. L’algorithme Google Panda attribue aux

Sommaire1 L’importance des méta-descriptions pour le référencement2 Qu’est-ce qu’une méta-description ?3 Quelle doit être la longueur d’une méta-description ?4 Pourquoi les méta-descriptions sont-elles importantes ?5 La méta-description est donc aussi importante que le texte de l’annonce.6 Comment puis-je rédiger de meilleures méta-descriptions ? L’importance des méta-descriptions pour le référencement Une

Qu’est ce que le volume de liens ? Cela fait référence à la quantité de liens sur une page. Le volume de liens à lui seul n’est pas une mesure fiable et corrélative des classements depuis près de dix ans. Certains liens ont une valeur exponentiellement plus élevée Il y

En quoi consiste un plan du site des images ? Un sitemap image typique contient l’URL et d’autres informations sur les images spécifiques que Google, Bing et d’autres moteurs de recherche doivent indexer. En résumé, les balises XML standard utilisées pour les sitemaps peuvent être décrites comme un schéma et

Qu’est-ce que le contenu dupliqué ? Le contenu dupliqué est un contenu qui apparaît sur l’internet à plus d’un endroit. Ce « seul endroit » est défini comme un emplacement avec une adresse de site Web unique (URL). Ainsi, si le même contenu apparaît à plus d’une adresse Web, il s’agit de

Se concentrer sur les mots-clés à longue traîne est une excellente tactique de référencement. Que sont les mots-clés de longue traîne ? Les mots-clés à longue traîne sont des mots-clés ou des phrases clés plus spécifiques – et généralement plus longs – que les mots-clés plus courants. Les mots-clés à

La requête locale Le référencement local, aussi appelé géographique, permet aux entreprises de faire la promotion de leurs produits et/ou services pour les clients situés à proximité. Une requête locale est une recherche dans laquelle l’internaute souhaite s’informer sur quelque chose dans un lieu spécifique, comme « cafés près de chez

Pourquoi la difficulté des mots-clés est-elle importante ? En bref : c’est une partie très importante du processus de recherche de mots-clés. Avec le volume de recherche mensuel et d’autres facteurs, la difficulté des mots-clés vous aide à choisir les meilleurs pour le référencement. Le seul problème est que chaque

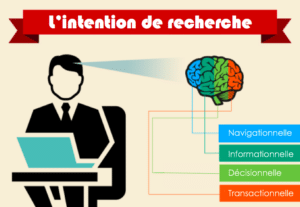

Que sont les requêtes de recherche informationnelles ? Les requêtes de recherche informationnelles proviennent de consommateurs qui recherchent simplement des informations spécifiques et qui ont des questions sur un sujet particulier. Les requêtes informatives sont difficiles à cibler. Google le sait, c’est pourquoi il a développé le Knowledge Graph pour

Noindex tag, quelques explications Les directives « Noindex » demandent aux moteurs de recherche d’exclure une page de l’index, ce qui la rend inéligible dans les résultats de recherche. Balises Meta Robots « Noindex » (sans index) La façon la plus courante de demander aux moteurs de recherche de ne pas indexer une

Les pénalités manuelles permettent à Google de déclasser ou de supprimer des pages ou des sites dans leur ensemble. Elles ne sont pas liées aux changements d’algorithmes tels que Penguin, Panda ou Hummingbird. C’est l’un des membres de l’équipe Google qui « punit » manuellement les sites qui ne respectent pas les

Que sont les X-robots-tag ? Il existe quelques types de directives qui indiquent aux robots des moteurs de recherche les pages et autres contenus que les robots seront autorisés à explorer et à indexer. Les plus courantes sont le fichier robots.txt et la balise meta robots. Le fichier robots.txt indique aux